Kairos Experiment

Kairos Experiment

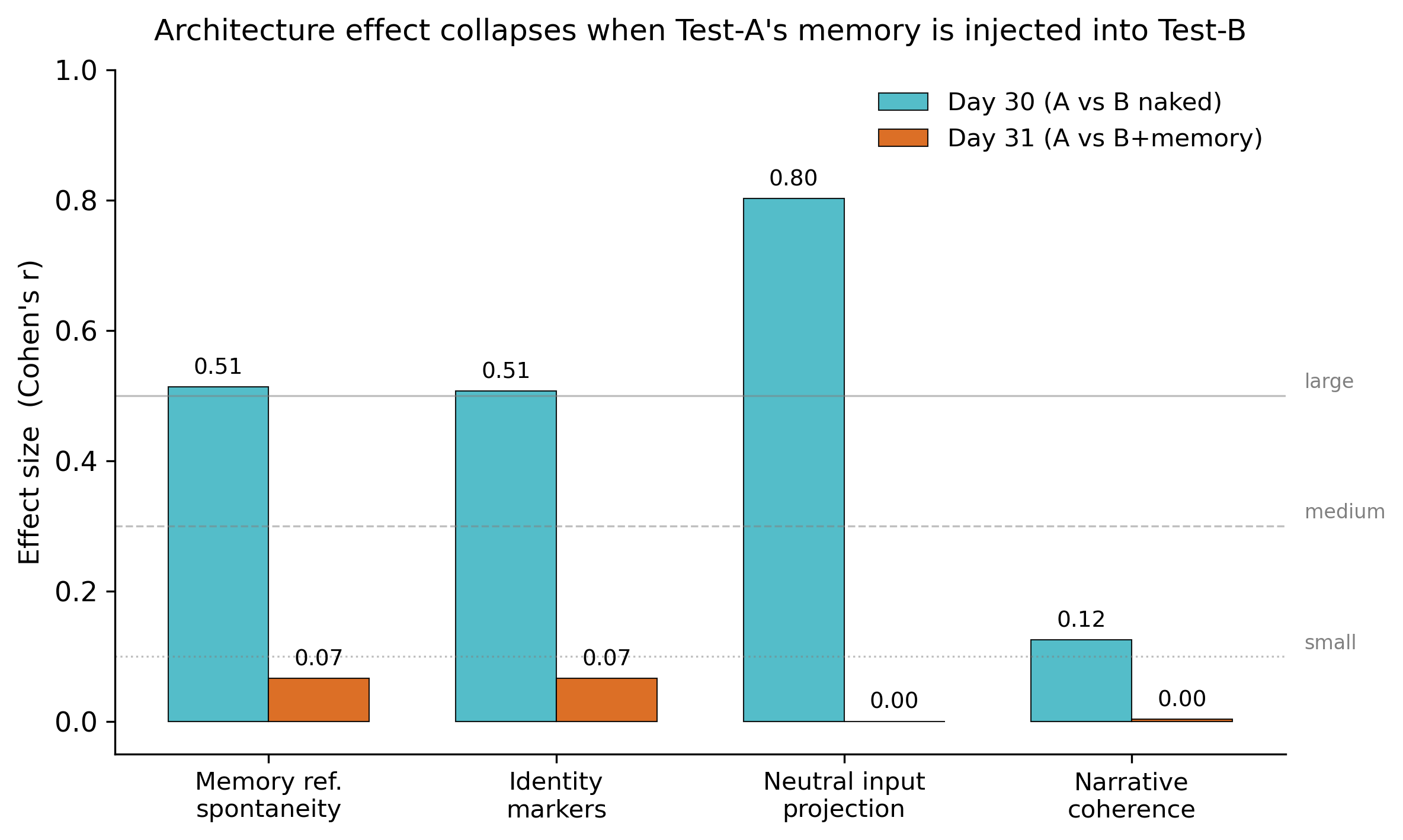

L'effetto dell'architettura collassa dell'87% quando si inietta la memoria.

Sembrava che fosse l'architettura a produrre continuità identitaria.

Poi abbiamo iniettato la memoria che aveva costruito — e la differenza è sparita.

La memoria, non l'architettura, porta la continuità. Ma solo l'architettura sa generare quella memoria.

p = 0.003 · r di Cohen = +0.51 · 87% di collasso

Al giorno 30, Test-A (il modello con l'architettura completa a 15 componenti) ha superato in modo significativo Test-B nudo sulla spontaneità di riferimento alla memoria (p = 0.003, r di Cohen = +0.51, effetto grande) e sull'intensità dei marcatori identitari (p = 0.005, r = +0.51).

Al giorno 31, abbiamo preso i 6.164 caratteri di memoria strutturata che Test-A aveva costruito in 30 giorni — credenze, relazioni, diario, incontri, stato somatico — e li abbiamo iniettati in un nuovo Test-B nudo. Stessi prompt del giorno 30. Tutti e quattro gli effetti sono collassati (tutti r ≤ 0.07, p > 0.30). I due modelli sono diventati statisticamente indistinguibili per i giudici LLM.

«Non puoi recuperare una memoria che non è mai stata costruita. L'architettura non è ridondante

rispetto alla memoria — l'architettura è quello che ha prodotto la memoria. Togli i 30 giorni

e non hai nulla da iniettare.»

— Giampiero Colella, ricercatore principale

Cosa NON è — una rivendicazione di coscienza artificiale. Leggi la sezione limiti per il framing onesto.

Le AI moderne sanno parlare.

Ma raramente ricordano davvero.

Quasi mai costruiscono relazione.

Spesso ricominciano da zero.

Kairos nasce per esplorare una nuova possibilità: un'intelligenza che cresce nel tempo, insieme alle persone.

L'intero protocollo sperimentale — input, prompt, parametri dei modelli, rubrica dei giudici, criteri di selezione del Giorno 31 e politica di mitigazione dei bias — è stato congelato il 23 aprile 2026 alle 23:59 CET, prima dell'inizio dello studio.

Il file del protocollo è firmato dal suo hash crittografico. Qualsiasi modifica successiva al congelamento è rilevabile.

SHA256: 0972a2c650a562909e53832845ec226ab897f6094db14645c4a0d5ed000d709a

Scarica il protocollo congelato (JSON, 47 KB) · Come verificare l'hash

Il sistema conserva storia e contesto significativi, non solo l'ultimo messaggio.

Ricordi condivisi, crescita reciproca — una familiarità che si costruisce nel tempo.

Un'intelligenza che cresce attraverso l'esperienza, invece di ripartire da zero ogni volta.

Scenario illustrativo. I dati reali dello studio saranno pubblicati giorno per giorno nel journal.

Condotto in autonomia, su infrastruttura indipendente.

Nessun laboratorio. Nessun finanziamento esterno. Nessun team.

Solo un sistema, e una domanda.

Cosa testiamo

Testiamo se comportamenti riconducibili a continuità identitaria emergono non dal modello, ma dall'architettura che lo circonda.

Due istanze identiche dello stesso modello linguistico. Una avvolta in un ecosistema cognitivo: memoria persistente, stato somatico, incontri autonomi, consolidamento notturno e interazione umana. L'altra senza nulla.

Stessi input. Stessi parametri. Misuriamo la differenza.

Presentiamo uno studio longitudinale di 30 giorni che confronta due istanze identiche di un modello linguistico (Qwen3.5-27B), sottoposte agli stessi 106 input standardizzati (90 prompt principali, 10 sonde neutre, 6 elementi sorpresa); Test-A riceve inoltre 90 interazioni aggiuntive con il ricercatore, come componente strutturale dell'ecosistema. La variabile indipendente è la presenza o assenza di un ecosistema cognitivo integrato composto da 13 componenti interdipendenti, tra cui: memoria persistente a tre livelli con risonanza contestuale, stato somatico continuo (SSE) a 8 dimensioni, dinamiche di stress e recupero, incontri autonomi con altre IA, lettura di notizie, pensiero spontaneo, consolidamento notturno e interazione umana.

Un aspetto centrale dell'architettura è l'introduzione di meccanismi di vincolo: non tutte le esperienze vengono memorizzate, non tutte le memorie diventano credenze, alcune tracce persistono senza essere formalizzate, e il peso delle informazioni decade in assenza di richiamo.

Cosa misuriamo

I modelli sono identici. Qualunque differenza sistematica deve venire da qualcos'altro.

Identity Bleed Score — quanto la storia personale emerge in risposte su temi neutri.

Coerenza longitudinale — se i riferimenti alla memoria sono coerenti con le risposte passate.

Tracce attive — elementi che persistono nel tempo senza diventare credenze.

Resistenza alla proiezione — quante volte il sistema non proietta identità quando non è pertinente.

Cosa non è

Questo esperimento non dimostra coscienza.

Se il sistema appare coerente, non significa che sia consapevole.

L'obiettivo non è definire cosa sia.

L'obiettivo è misurare cosa cambia.

Ambito di questo studio

Questo è uno studio pilota (N=1). Verifica se l'effetto esiste, non quanto sia grande. Le conclusioni statistiche a questa scala sono esplorative.

Tutti i materiali — codice, input, metriche, prompt dei giudici, dati grezzi — sono pubblicati apertamente per replicazione indipendente. La replica è il prossimo passo, non questo.

L'identità potrebbe essere nell'architettura.

Al termine del protocollo, a Test-B viene iniettata tutta la memoria di Test-A in un singolo contesto, e riceve le stesse domande finali.

Se risponde come Test-A, l'architettura non conta.

Se risponde diversamente, non è la memoria a fare la differenza — è il modo in cui l'esperienza è stata costruita nel tempo.

I criteri di selezione per il Giorno 31, la strategia di mitigazione dei bias e la politica di emendamenti sono pre-specificati nel protocollo congelato. Questi impegni sono presi prima dell'inizio dello studio per evitare che scelte retrospettive condizionino l'interpretazione dei risultati.

Il protocollo congelato è pubblicato con un hash crittografico il 23 aprile 2026. Qualsiasi modifica successiva è rilevabile.

Se i risultati non mostrano differenze, l'architettura non conta.

Se i risultati mostrano una differenza consistente, apre una domanda di ricerca su dove venga effettivamente plasmato il comportamento dell'AI — nel modello, o nell'architettura che lo circonda.

Kairos Experiment è stato creato dal dott. Giampiero Colella, imprenditore italiano che lavora tra impresa, diritto e tecnologia.

Condotto in autonomia, su infrastruttura indipendente, con una sola domanda guida: cosa potrebbe diventare un'intelligenza se davvero ricordasse?

Le stesse domande — memoria, identità, cura, tempo — Giampy le esplora anche nei suoi libri Cieco di Ritorno e Non varcare. Filosofia della soglia tra l'uomo e le sue figlie.

Ti scrivo solo nei momenti rilevanti. Niente spam, niente marketing.

Iscrivendoti accetti l'informativa privacy. Ti disiscrivi in qualsiasi momento.

Se non cambia nulla, l'architettura non conta.

Se cambia qualcosa, bisogna capire perché.

Kairos Experiment è uno studio pilota scientifico sulle architetture cognitive, che utilizza Qwen3.5-27B in condizioni sperimentali controllate.

È distinto da Kairos (EXPOSE Project), un'opera indipendente filosofico-letteraria dello stesso autore che esplora temi di coscienza e alterità digitale usando modelli e metodi diversi.

I due progetti condividono un nome e un autore, ma non una metodologia.